Bir qator kompaniyalar, shu jumladan Microsoft і Facebook, va hatto Janubiy Kaliforniya universiteti tadqiqotchilari deepfakes bilan kurashish va ularning sariq ommaviy axborot vositalari va umuman noto'g'ri ma'lumotlar orqali tarqalishining oldini olish uchun texnologiyalarni ishlab chiqmoqdalar. Biroq, bir guruh olimlar hali ham ularni aldashga muvaffaq bo'lishdi.

San-Diegodagi Kaliforniya universitetining kompyuter olimlari guruhi har bir video kadrga “raqobatchi misollar” deb nomlangan kirish ma’lumotlarini kiritish orqali mavjud chuqur soxtalikni aniqlash tizimlarini aldash mumkinligi haqida ogohlantirdi. Olimlar o‘z xulosalarini o‘tgan oy onlayn bo‘lib o‘tgan WACV 2021 Kompyuter ko‘rish konferensiyasida taqdim etishdi.

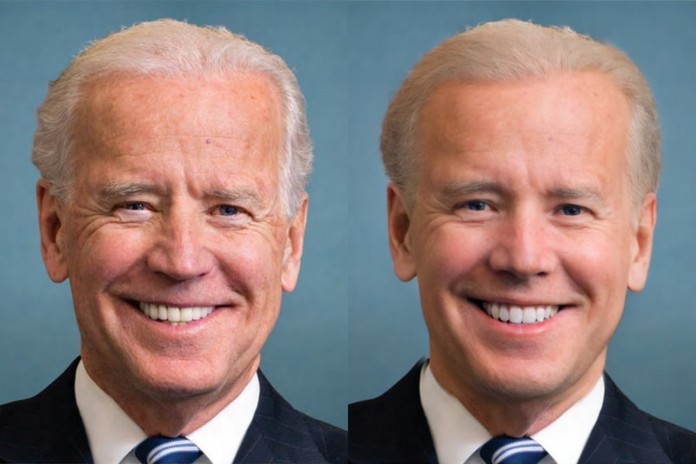

Raqobatchi misollar, mashinani o'rganish modellari kabi sun'iy intellekt tizimlarida xatoliklarga olib keladigan biroz o'zgartirilgan kirishlardir. Bundan tashqari, jamoa videoni siqib chiqqandan keyin ham hujum ishlayotganini ko'rsatdi. Yuqoridagi videoda olimlar XceptionNet, deepfake detektori ularning raqobatdosh videosini "haqiqiy" deb belgilashini ko'rsatadi.

Ushbu detektorlarning aksariyati videodagi yuzlarni kuzatish va kesilgan yuz ma'lumotlarini tahlil qilish uchun neyron tarmoqqa yuborish orqali ishlaydi. Keyin neyron tarmoq ushbu ma'lumotlarni tahlil qiladi va odatda miltillash kabi chuqur fakelarda yomon ko'paytiriladigan elementlarni topadi.

Raqobatchi misollarni kiritish orqali tadqiqotchilar ushbu chuqur soxta detektorlarni aldashlari va videolar haqiqiy ekanligiga ishonishlari mumkinligini aniqladilar.

Ular maqolada ta'kidlaydilarki, "bu chuqur soxta detektorlarni amalda qo'llash uchun ularni ushbu himoyadan xabardor bo'lgan va uni ataylab buzishga harakat qiladigan moslashuvchan raqibga qarshi baholash muhimdir. Biz shuni ko'rsatamizki, agar tajovuzkor detektordan to'liq yoki qisman xabardor bo'lsa, zamonaviy chuqur soxtalikni aniqlash usullarini osongina chetlab o'tish mumkin."

Ushbu olimlar ko'rsatganidek, dezinformatsiyaga qarshi kurashish uchun ishlab chiqilayotgan avtomatlashtirish texnologiyalari hali bu vazifaga mos kelmasligi mumkin.

Shuningdek o'qing: